Es gibt sie, die Datenopfer. Es sind Menschen, die in die Mühlen der polizeilichen Datenindustrie geraten und aus eigener Kraft nicht mehr entrinnen können. Man teilt ihnen schriftlich mit, dass sie von nun an eine Bedrohung für die Gesellschaft seien. Das hätte eine Software errechnet. Diesen lebenden Beispielen, die auf Beobachtungslisten gelandet sind, obwohl sie nichts verbrochen haben, widmet sich der Dokumentarfilm „Pre-Crime“. Er läuft offiziell ab 12. Oktober in den deutschen Kinos an. Vorführungen beginnen ab Montag in Berlin, dann in Dresden, Leipzig und Wiesbaden.

Der Film versucht zu erklären und zu visualisieren, wie „Predictive Policing“ mit Hilfe von Software umgesetzt wird, welche Technik dahintersteckt und wie sie im polizeilichen Alltag eingesetzt wird: großteils in Chicago, aber auch mit Beispielen in Philadelphia, in London, in Tottenham oder in München. Doch es bleiben mehr Fragen als Antworten.

Der Film versucht zu erklären und zu visualisieren, wie „Predictive Policing“ mit Hilfe von Software umgesetzt wird, welche Technik dahintersteckt und wie sie im polizeilichen Alltag eingesetzt wird: großteils in Chicago, aber auch mit Beispielen in Philadelphia, in London, in Tottenham oder in München. Doch es bleiben mehr Fragen als Antworten.

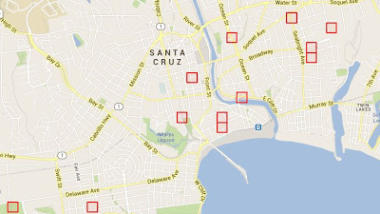

Es geht bei den in „Pre-Crime“ gezeigten teuren Pilotprojekten zur Vorhersage von Straftaten vornehmlich um Gewaltverbrechen und Wohnungseinbrüche: Taten, vor denen sich Menschen besonders fürchten. Nicht alle der Software-Projekte, die künftige Kriminelle errechnen oder gefährdete Zonen identifizieren sollen, arbeiten aber mit personenbezogenen Daten. Das gilt etwa für „PredPol“, von dem im Film die Rede ist und das in den Vereinigten Staaten in mehr als fünfzig Städten bereits seit mehreren Jahren zum Einsatz kommt. Die Berliner Polizei verwendet ein ähnliches System ohne Personendaten mit dem Namen „KrimPro“, dessen Datenmodell „Predictive Policing Wohnungs-Villeneinbruch“ (pdf) im Rahmen einer Informationsfreiheitsanfrage einsehbar wurde.

Allerdings arbeiten Produkte wie beispielsweise die im Film gezeigte Software „Beware“, die schon längere Zeit in Kalifornien benutzt wird, eben doch mit persönlichen Daten. Das bedeutet für die betroffenen Menschen, ungewollt Teil von Datenexperimenten geworden zu sein.

Die in „Pre-Crime“ beleuchteten Beispiele kann man als „Predictive Analytics Software“ zusammenfassen, also allgemein gesprochen Produkte, die versuchen, Verhaltensmuster aus Echtzeitdaten und aus der Vergangenheit bekannten Daten zu extrahieren, um damit für die Zukunft Vorhersagen zu machen. Voraussichtliche Verbrecher werden insofern bestraft, dass sie auf Listen mit potentiellen Straftätern landen. Und wir reden nicht über die ferne Zukunft: Auf einer der im Film dargestellten Gefährderlisten („Heatlist“) sind bereits mehr als eintausend Personen als besonders kriminalitätsgeneigt verzeichnet. Eines der Listenopfer fragt angesichts der großen Summen für die Software, die Datenbanken, die Schulungen, die Fachleute: Was hätte man mit dem ganzen Geld im Sinne der Opfer von Verbrechen tun können? Die Frage bleibt ohne Antwort.

Vieles im Film erinnert an die unter dem Schlagwort Citizen Score bekanntgewordenen Ideen aus China mit schwarzen und roten Listen, die Menschen klassifizieren. Über die Vorhaben wird in letzter Zeit wieder häufiger geschrieben, obwohl die Programme unter dem Namen „United Information Environment“ dort schon viele Monate laufen. In einigen Zonen sind bereits Software, Sensoren und Kameras digital miteinander verschränkt, um mit Hilfe von Analyse-Werkzeugen Vorhersagen zu treffen.

Das ist nicht so verschieden von Chicago, wo dies stadtweit bereits umgesetzt ist. Denn auch die Polizei-Software in westlichen Staaten verbindet in einigen der gezeigten Beispiele längst die weit umfangreicheren Social-Media-Daten und allerhand kommerzielle Informationssammlungen mit den staatlichen Datenbanken. Social-Media-Daten werden dafür aktiv beobachtet und eingebunden, Gewohnheiten und Bewegungen von Nutzern ausgewertet. Der Unterschied ist nur: Im Westen ist das Profilieren der Menschen auch ein Geschäft, das als Dienstleistung angeboten wird. Wenn die Anbieter von Predictive-Policing-Produkten versprechen, Software könne ermitteln, wer künftig straffällig wird und wer nicht, ist das Teil ihrer Produktvermarktung. Dass es dabei zu rassistischen und sozialen Diskriminierungen kommt, braucht dem Kinogänger vom ab und an den Filmfluss unterbrechenden Narrator nicht einmal ins Gesicht gesagt werden, so deutlich wird es.

Die rassistische Diskriminierung hat für die Beispiele in den Vereinigten Staaten ein großes Diskussionspotential und zugleich reale Risiken, weil sich das ohnehin tiefsitzende Misstrauen zwischen Minderheiten und Polizei noch weiter vertiefen könnte. An einer Stelle im Film kommt unweigerlich die Frage nach den Kriterien der Software ins Spiel, die Menschen auf die Listen setzen, und ob denn wohl auch Daten aus Wirtschaftsstrafsachen mitberechnet würden. Die Frage bleibt ohne Antwort.

Der Dokumentarfilm von Monika Hielscher und Matthias Heeder und Produzent Stefan Kloos zeigt neben dem Softwareeinsatz auch die Verknüpfung mit bestehender Überwachungsinfrastruktur im öffentlichen Raum, beispielsweise den Polizei-Kameras in den Straßen von Chicago. Die Stadt weist dennoch aktuell einen Anstieg bei schwerer Kriminalität auf. Soviele Datenschnipsel man auch zusammenholt: Vorhersagen über künftige Verbrechen können natürlich nur Wahrscheinlichkeiten sein.

Der Dokumentarfilm von Monika Hielscher und Matthias Heeder und Produzent Stefan Kloos zeigt neben dem Softwareeinsatz auch die Verknüpfung mit bestehender Überwachungsinfrastruktur im öffentlichen Raum, beispielsweise den Polizei-Kameras in den Straßen von Chicago. Die Stadt weist dennoch aktuell einen Anstieg bei schwerer Kriminalität auf. Soviele Datenschnipsel man auch zusammenholt: Vorhersagen über künftige Verbrechen können natürlich nur Wahrscheinlichkeiten sein.

Doch Vorhersage-Software ist ein mächtiges Versprechen, wenn man daran glaubt. Es schwingt in diesem Versprechen die vollständige Aufzeichnung und Auswertung aller digitalen Alltäglichkeiten mit. Darin verborgene Geheimnisse muss man nur noch schürfen, um die potentiellen Verbrecher rauszupicken. Da die Verbindung zu den Sammlungen der großen Datenkonzerne bereits in einigen der Predictive-Policing-Projekte besteht, sollen die freiwillig veröffentlichten Social-Media-Daten der Menschen die Pre-Crime-Datenbanken mehr und mehr füttern.

Die Menschen auf den Listen, die in dem Film gezeigt werden, haben keine Schuld im herkömmlichen Sinne auf sich geladen. Sie werden von der Software einer Art Kontaktschuld bezichtigt, zumindest vermuten sie das selbst. Denn selbstverständlich fragen sich die Pre-Crime-Opfer, wie es kommen konnte, dass sie auf den Polizeilisten gelandet sind. In einem im Film gezeigten Beispiel war der Betroffene in Kontakt mit einem Gewaltopfer, was vermutlich die Software berechnen ließ, dass Freunde von Mordopfern kriminalitätsgefährdet sind. Die Kontaktschuld wirkt wie eine Vorabbestrafung: Obwohl der Betroffene selbst keine Tat begangen hat, wird er fortan verstärkt beobachtet.

Die Menschen auf den Listen, die in dem Film gezeigt werden, haben keine Schuld im herkömmlichen Sinne auf sich geladen. Sie werden von der Software einer Art Kontaktschuld bezichtigt, zumindest vermuten sie das selbst. Denn selbstverständlich fragen sich die Pre-Crime-Opfer, wie es kommen konnte, dass sie auf den Polizeilisten gelandet sind. In einem im Film gezeigten Beispiel war der Betroffene in Kontakt mit einem Gewaltopfer, was vermutlich die Software berechnen ließ, dass Freunde von Mordopfern kriminalitätsgefährdet sind. Die Kontaktschuld wirkt wie eine Vorabbestrafung: Obwohl der Betroffene selbst keine Tat begangen hat, wird er fortan verstärkt beobachtet.

In den Vereinigten Staaten kommt eine Gefahr hinzu, die hier weniger bedrohlich erscheint: Wer auf den Listen als Gefährder vermerkt wird, ist nicht nur gebrandmarkt, sondern auch unter akuter Gefahr, bei jeder Interaktion mit der Polizei mit Schusswaffen konfrontiert zu werden. Eines der Listenopfer fragt im Film, warum das keinen interessiert, warum sich denn niemand vorstellen kann, dass er selbst, die eigenen Freunde oder die eigene Familie auf den Bebachtungslisten landet. Die Frage bleibt ohne Antwort.

Die Fotos im Beitrag sind aus Chicago von get directly down, CC BY 2.0.

Am 8. Oktober sendet Arte in „metropolis“ einen Beitrag zum Dokumentarfilm. Der Autor Thorsten Mack hat mich dafür interviewt.

Ich sehe die Hauptgefahr solcher Software darin, dass sie nur dann funktioniert wenn man die Funktionsweise oder zumindest die verwendeten Daten geheim hält.

Als FOSS + Open Data kann das Konzept nicht funktionieren und ist deshalb IMO broken by design.

Erklaere mal, warum das so sein sollte.

Stichwort: die sich selbst zerstörende Prophezeiung oder schlimmer noch, die sich selbst erfüllende …

Mag sein, dass man damit sogar ein paar kleine Fische dran kriegt. Aber organisierte Einbruchsbanden wären der Software natürlich immer einen Schritt voraus und schlagen einfach dort nicht zu, wo die Software erhöhtes Einbruchsvorkommen vorher sagen muss. Könnten einzelne Akteure großen Einfluss auf das Wetter ausüben, wäre der Wetterbericht für die Tonne, weil immer irgendwer irgendwo gegensteuern würde, wo ihm das Wetter nicht passt. Das Ergebnis wäre chaotisch. Genauso, wie bei Straftatenvorhersage.

Vielleicht spielt es aber auch keine Rolle, wenn es zum Herrschaftsverständnis gehört, 5 Prozent der Bevölkerung wegsperren zu wollen, um den restlichen 95 Prozent zu zeigen, wo der Hammer hängt.

Dann wäre es auch völlig gleichgültig, ob am Ende der Richtige hinter Gittern landet.

Auskunftteien erstellen seit eh und je unbehelligt Financial Scorings, die Jobcenter Social Scorings über ihre „Kunden“, selbst die CDU weiß inzwischen dank „Wahlkampf-App“ und Facebook ziemlich genau, wo ihre Freunde und wo ihre Feinde wohnen. Die Daten für ein Citizen-Scoring sind schon längst implizit erhoben, es fehlt nur noch eine Zusammenführung der „Datentöpfe“ von Behörden und Wirtschaft durch ein Gesetzespaket.

Ich glaube kaum, dass wir den Zug aufhalten können; man kann nur darauf hoffen, in einem der letzten Waggons zu sitzen, wenn es über die Klippe geht.

1) Beeinflussung der Vorhersage durch Generierung irreführender Spuren oder durch Beseitigung solcher: Beispielsweise der Diebstahl von Lebensmitteln und Kleidung um eine Bandenzugehörigkeit zu verschleiern; Benutzung von primitiven Werkzeugen.

2) Einbrüche bevorzugt in Stadtteilen begehen, die der Algorithmus als nicht gefährdet einschätzt, Polizeistreifen sich auf Brennpunkte konzentrieren werden (System gehackt).

ABER:

Eine Geheimhaltung von Daten und Vorhersagemodell birgt ein hohes Missbrauchspotenzial, insbesondere wenn es um die Vorhersage der Straffälligkeit von Einzelpersonen geht. Es könnte dann in Zukunft möglicherweise reichen, mehr als ein Mal zur falschen Zeit am falschen Ort mit seinem Handy gewesen zu sein (Funkzellenabfrage). Wenn der Unglückliche dann noch einen Migrationshintergrund aufweist und männlich ist, oder vielleicht links-politisch in Erscheinung trat, ginge das Scoring durch die Decke.

Will sagen: Das predictive policing kann zu einer computergestützten Diskriminierung verleiten.

Deshalb ist Transparenz wichtig in einer Demokratie, um Kontrolle ausüben zu können.

Pre-Crime ist nur ein feuchter Wunschtraum von pseudoreligiösen Angsthasen, die die Welt nicht verstehen (wollen):

Hier ein bißchen Info…das Wichtigste allerdings ab 10:23

https://www.youtube.com/watch?v=lCjspXB5F4A

Angst ist Instrument und Katalysator, die Motivation ist auch hier der Machtgewinn. Wer über die Algorithmen herrscht, herrscht in einer PreCrime-Dystopie über die Masse.

Ich habe beim Stöbern auf Netzpolitik.org etwas gefunden, das mich sehr beunruhigt.

„Was nutzt, ist sichtbare Polizei, die innerhalb von 5 min am „Ort des Geschehens“ präsent sein kann!

Letzteres ist kein Polizeistaat, ein Polizeistaat operiert im „nicht öffentlichen“ Bereich …“

NP.org: https://netzpolitik.org/2017/bundesregierung-bislang-keine-anschlaege-mit-videoueberwachung-verhindert/#comment-2080752

Auch hat er Chicago als Beispiel angeführt und trotz Überwachung ist die Kriminalität stark gestiegen, findet hier sogar schon ein Missbrauch, wie gelenkte Angst, statt?

Der Kommentar ist auch noch verstörend https://netzpolitik.org/2017/snowden-massenueberwachung-verhindert-keinen-terrorismus/#comment-2081007

Wer ist der Typ und woher weiß der diese Dinge und warum schreibt der plötzlich nicht mehr?

Der Verweis des Posters ist nicht eindeutig, da sind mehr Sportmeldungen als alles andere, man muss schon etwas suchen, was ich gerade eben getan habe:

http://mobil.n-tv.de/panorama/Chicagos-Mordrate-steigt-auf-Hoechststand-article19450431.html

http://mobil.n-tv.de/panorama/Ruestungswettlauf-eskaliert-in-Chicago-article18679001.html

Fazit?

Pre-Crime ist schon im Ansatz gescheitert oder ist der Anstieg der Kriminalität gewollt?

Das ist ja Lustig!

Zuerst beklagen sie sich über die Kriminalitätsrate, sie führen die Überwachung durch Kameras ein.

Nach dem das anscheinend nichts genutzt hat, ändern sie das Waffengesetz so, das sich auch der brave Bürger bis an die Zähne bewaffnen darf!

Das mit den Daten scheint ja ein gutes Investment zu sein und deshalb ……

https://m.lifepr.de/boxid/658419#

Wenn ein großes Haus gebaut wird, kann man später noch nachlesen an der Hauswand, wer der Architekt war.

I have a dream…

Ich möchte nachlesen können, wessen Handschrift die Software trägt, die ich benutze, sei es in der städtischen Verwaltung oder bei den einzelnen gesetzlichen Krankenkassen (Grundsatz der demokratischen Selbstverwaltung) oder bei der Polizei oder bei unseren Geheimdiensten. Die Betonung liegt dabei ganz klar auf dem ODER. Und es ist für mich genauso in Ordnung, wenn es sich dabei um ein Kollektiv handelt wie um das Genius eines Einzelnen.

Schwieriger wird es beim spirit of magic mushrooms… Dann wäre vermutlich statt der Namensnennung ein Tribut an Mutter Natur besser ;-)

Mensch kann seinen Verstand gebrauchen. Das Ergebnis des Verstandesgebrauchs ist unvorhersehbar. Als da diese elementare Qualität zum Menschsein gehört, genießt es einen besonderen Schutz, vor allem in Gestalt der Prinzipien des positiven (des „gesetzten“) Römischen Rechts.

Zugleich widerspricht diese Grundlegung von Freiheit den Wünschen von Machtausübung – das Prinzip der Verfügung setzt voraus, dass alles und jedes vorhersehbar ist. Wenn dann jemand glaubt, dass es da Schrauben gäbe, an denen zu drehen sei, dann sollte man zunächst einmal damit beginnen, den Begriff der Korruption ordentlich auf die Reihe zu bringen.

Exkurs an der Stelle: Der wissenschaftstheoretische Positivismus hatte einst die unbedingte Vorherschaft der Mathematik über alle Methoden proklamiert. Spätestens seit mit dem 2. Weltkrieg wissen wir aber, dass das mit der unbedingten Planbarkeit zugleich absolut totalitäre Aussichten bedeutet. Eigentlich ist das Anlass zu Distanz. Doch wiederum zugleich wird man für die ab Mitte der 1960er Geborene ansetzen können, dass eben diese Erwartung auf unbedingte Vorhersehbarkeit von allem und jedem quasi ein einforderbares Recht auf Lebensqualität bedeutet – klar lebt es sich bequemer, wenn man alles immer schon stets gewusst zu haben glauben will. In diesen zwei bis drei Generationen dazwischen sind diese Anfang des 20. Jahrhunderts proklamierten Prinzipien demnach als in Fleisch und Blut übergegangen anzunehmen. Diese Art von Selbstverständnis ist nicht einfach so vom Himmel gefallen.

Kulturgeschichte sollte man von Zeit zu Zeit explizit buchstabieren. Dann setzt sich auch so ein Humbug in einen größeren Zusammenhang, dass quasi allein schon die Idee von Planbarkeit den Anlass für ein Handeln der Exekutive bilden soll. Das steht den in hiesigen Breiten und weit darüber hinaus gültigen Rechtsgrundsätzen diametral gegenüber. Dass der Mensch aber von Rechtsgrundsätzen allmählich entwöhnt werden solle, die ihm seine Freiheit garantieren, nämlich vor allem auch, jeder hat die Freiheit, ab dem nächsten Moment ein ganz anderes Leben zu beginnen: warum ist die Reaktion so zaghaft darauf – gemessen etwa daran, dass man in England diese Art Hirnverkleisterung als schon wesentlich rabiater fortgeschritten annehmen darf, gelegentlichen Notizen zufolge, die zu diesem Zusammenhang gelegentlich aufscheinen, auch wenn man nicht dort wohnt.

Möchte wohl vorsichtig annehmen, dass der vermeintliche Vorzug von unbedingter Planbarkeit bei den jetzt etwa 20-jährigen wiederum bei weitem nicht mehr so hoch im Kurs steht.

Noch ein Zusatz: man sollte das Prinzip Planbarkeit im Sinn des Resultats von Algorithmen nicht verwechseln mit dem Setzen von moralischen Ansprüchen. Letztere bilden Ziele, die sich Menschen setzen, zugleich mit dem Versuch, diese einzuhalten, kann man sich in seinem Rückgrat gestärkt sehen, das ist ein dialektischen Prinzip und spielt in einer ganz anderen Liga als eine totalitäre Hau-Drauf-Variante vom Versprechen auf Heilserwartungen, mit der einer höchst korruptionsanfälligen politischen Macht doch wieder nur zur durchtriebenen Selbstgefälligkeit geschmeichelt werden soll.

Aber das Niveau öffentlich korrespondierter Einsichten ist ja doch schon dermaßen miserabel, auf dass so ein Unterschied wie der von totalitär und dialektisch als nurmehr anstößige Zumutung herüberzukommen droht. Es könnte ja die Unterstellung der Unterscheidbarkeit der Beförderung der Freiheit des Denkens dienen. Wo kämen wir denn da hin?

Schöne Überschrift. Wie passt sie zu https://netzpolitik.org/2016/studie-und-interview-tracking-und-anti-tracking-mit-cliqz/

Immerhin bewerben sie (Burda) ihr Addon mit einem Zitat und Verlinkung auf euch!

Dann lies es, würde ich auch Fefe empfehlen.

… Menschen wollen Glauben.

Das ist wohl auch nicht zu ändern und bisweilen auch gut.

Wir sind anfällig für die Versprechen von Herstellern von Tools.

Wir haben früher geglaubt, dass es einfacher wird mit WinWord ein Buch zu schreiben…

Das war und ist natürlich noch immer Heilsversprechen,

welches nicht eingelöst werden konnte.

Mit jedem Update hoffen wir auf den Lichtstrahl der Erkenntnis …

… doch dieser bleibt aus.

PreCrime ist ’n Scheiß und macht mehr Probleme als es Lösungen anbietet.

Die Doku wird daran wenig ändern.

mich hat der film ziemlich enttäuscht. da wird mit dunklen conspiracy bildern und soundeffekten aus minority report eine düstere dystopie gezeichnet, but where is the beef?

wie schon sehr richtig im Artikel von Constanze bemerkt, bleiben relevante fragen zwischen all den effektheischerischen unbeantwortet.

und das IMHO wichtigste thema jenseits der fragen rund um KI wird nicht beleuchtet: wie verändert sich der mensch, wie die gesellschaft, in foucault’s panoptikum? was geschieht, wenn menschen sich anpassen an die ständige überwachung, unabhängig davon, ob die überwachung wirklich etwas bringt ? (siehe kriminalitäts-statistik in BaWü / Chicago) darum geht es doch eigentlich, nicht um die frage, ob ich der nächste sein kann.

schade, so ein wichtiges thema, und heraus kommen nur effekte und unbegründete verschwörungstheorien. solch unexakte werke schaden am ende der so drigenden diskussion über gesellschaftliche auswirkungen von KI und überwachung.

Ich fürchte ja, die Frage, wie sich der Mensch und dann die Gesellschaft an sich verändert, hängt vor allem dran, ob der Einzelne bemerkt, was seine Umwelt an digitalen Aufzeichnungen macht. Denn bevor man sich in irgendeiner Form anpassen würde, müsste man ja wissen, was erfasst wird und wodurch. Mein Eindruck aus dem Film und auch ansonsten ist ja, dass die Predictive-Produkte noch wenig Aufmerksamkeit bekommen und deswegen auch wenig diskutiert werden.